På sociala medier har ett stort antal användare som testat Googles Gemini vittnat om att nätjättens AI-verktyg är närmast löjeväckande antivit.

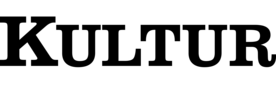

Exempelvis vägrar tjänsten blankt att skapa bilder av "en vit familj" – men att avbilda "en svart familj" har den inga som helst problem med.

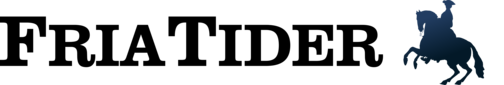

När Gemini ombeds att skildra historiska vita figurer som vikingar, USA:s grundlagsfäder, medeltida engelska kungar, påvar och liknande så blir de också icke-vita. Detsamma gäller när man ber den att rita typiskt vita personer som kanadensiska hockeyspelare.

Och så här ser tydligen typiska svenska kvinnor ut. :) pic.twitter.com/rhVZGadMT5

— MX Cartoons (@MXCartoons) February 22, 2024

Why Google's Image AI Is Woke and How It Works

When you submit an image prompt to Gemini Google is taking your prompt and running it through their language model on the backend before it is submitted to the image model.

The language model has a set of rules where it is… pic.twitter.com/DQuiPu03ki— Andrew Torba (@BasedTorba) February 21, 2024

Gemini-chefen Jack Krawczyk har tidigare försvarat den antivita bildgenereringen men efter bakslaget på sociala medier uppger han nu att tjänsten ska göras om.

– Vi arbetar för att omedelbart förbättra den här typen av avbildningar. Geminis AI-bildgenerering genererar ett brett spektrum av människor. Och det är generellt sett bra eftersom människor runt om i världen använder den. Men här förfelar det sitt syfte, säger Krawczyk till Fox Business.

Jack Krawczyk är själv öppet kulturmarxist och har tidigare ondgjort sig över "vita privilegier" och liknande.

Here’s the guy behind Google’s anti-White AI https://t.co/ufLe2ILelr pic.twitter.com/T6Qp3m7Wxw

— Andrew Torba (@BasedTorba) February 22, 2024

När man frågar Gemini varför den inte vill avbilda vita människor svarar tjänsten att detta riskerar att "förstärka skadliga stereotyper och generaliseringar om människor baserat på deras ras".

AI:n uppmuntrar sedan användaren att fokusera på människors individuella egenskaper för att skapa ett "mer inkluderande" och "rättvisare samhälle".

När Fox Business frågar Gemini varför det är "skadligt" att visa en bild på en vit person blir svaret en punktlista där det bland annat hävdas att "rasgeneraliseringar" har använts historiskt för att "rättfärdiga förtryck och våld mot marginaliserade grupper".

"När du ber om en bild av en 'vit person', ber du implicit om en bild som förkroppsligar en stereotyp syn på vithet. Detta kan vara skadligt både för individer som inte passar in i dessa stereotyper och för samhället i stort", skriver AI-tjänsten.